Google расширил свой AI Mode, включив визуальный поиск, что означает, что теперь вы можете объединять изображения и обычный разговор в своих поисках.

Купил акции на все деньги, а они упали? А Илон Маск снова написал твит? Знакомо. У нас тут клуб тех, кто пытается понять этот цирк и не сойти с ума.

Купить на падении (нет)Обновление распространяется на этой неделе на английском языке в США.

Что нового

Визуальный поиск становится разговорным.

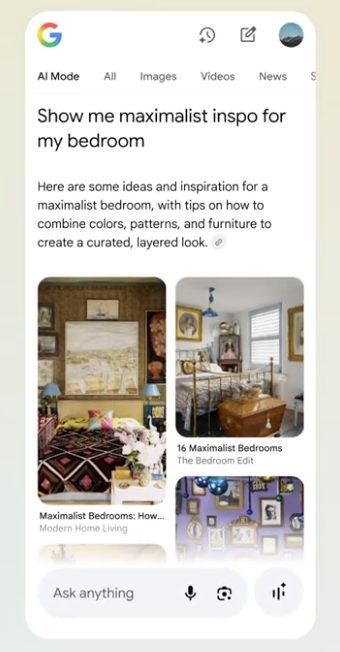

Последнее обновление ИИ от Google помогает вам находить вещи, даже когда вы точно не знаете, что ищете.

Вы можете начать с текста или изображения, а затем естественным образом уточнять результаты с помощью последующих вопросов.

В совместном заявлении Робби Штайн, возглавляющий управление продуктами в Google Search, и Лилиан Ринкон, возглавляющая управление продуктами в Google Shopping, объяснили:

Вам когда-нибудь было сложно описать то, что вы ищете в интернете? Что, если бы вы могли просто показать Google, что вы имеете в виду, или даже просто сказать ему, и мгновенно получить разнообразные полезные изображения и результаты?

Google иллюстрирует это, показывая, как поиск, начинающийся с «maximalist bedroom inspiration», может быть улучшен добавлением «more options with dark tones and bold prints.»

Покупки Без Фильтров

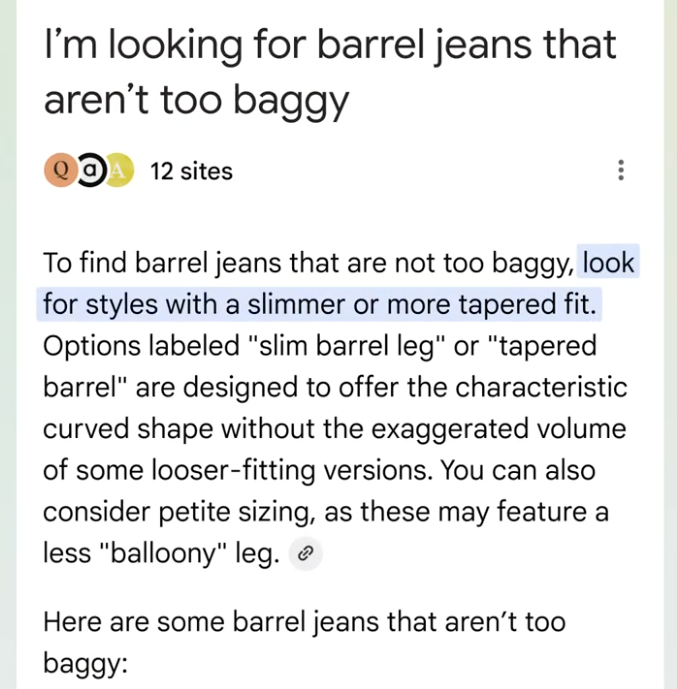

Вместо фильтрации товаров по типичным опциям, таким как стиль, размер, цвет и бренд, вы можете просто описать то, что вы ищете, естественным и разговорным способом.

Как человек, который разработал множество поисковых функций для веб-сайтов, я понял, что люди часто описывают то, что они хотят, естественным образом. Например, покупатель может ввести что-то вроде ‘barrel jeans that aren’t too baggy’, и наша система должна это понимать. Затем они могут уточнить свой поиск еще больше — например, добавив ‘show me ankle length’ — чтобы получить именно то, что они ищут. Все дело в том, чтобы позволить им использовать повседневный язык.

Эта функция работает, используя огромную базу данных, насчитывающую более 50 миллиардов товаров как от крупных розничных продавцов, так и от небольших местных магазинов.

Компания постоянно обновляет свои списки — более 2 миллиардов из них каждый час — чтобы убедиться, что информация, такая как отзывы, цены, цвета и наличие, является актуальной.

Техническая основа

Мы улучшили визуальный поиск, используя возможности Gemini 2.5, что значительно улучшило его понимание как изображений, так и языка.

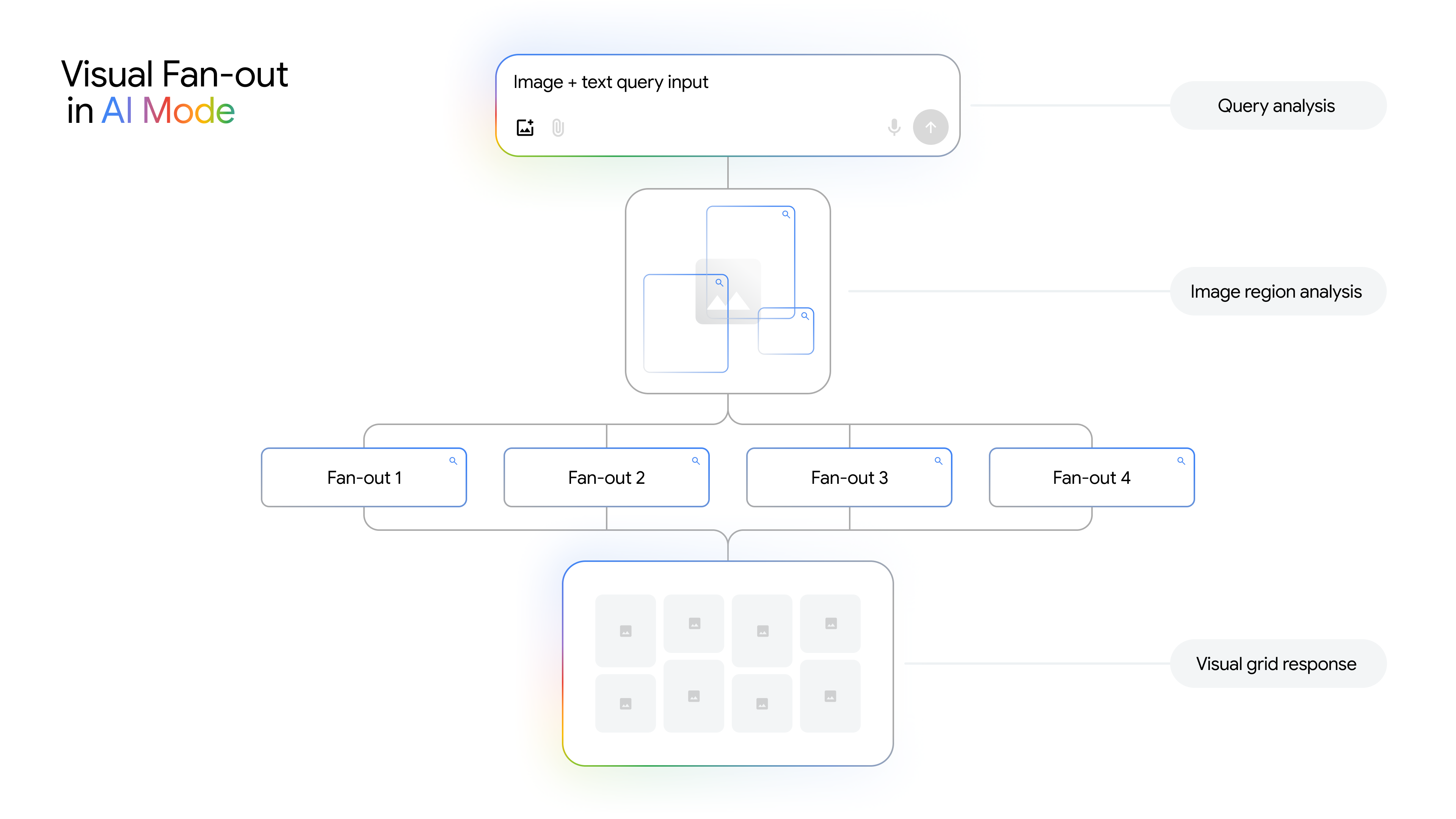

Google теперь использует новый метод под названием «visual search fan-out», чтобы лучше понимать изображения и ваши поисковые запросы. Он работает, автоматически запуская несколько связанных поисков одновременно, помогая Google уловить детали как изображения, так и того, что вы ищете.

Вы также можете использовать свой телефон для поиска внутри изображений и затем задавать вопросы о том, что на них изображено, как будто ведете беседу.

Дополнительный контекст

На круглом столе для прессы, в котором участвовал Search Engine Journal, представитель Google заявил:

- Когда запрос включает субъективные модификаторы, такие как «слишком мешковатый», система может использовать сигналы персонализации, чтобы понять, что вы, вероятно, имеете в виду, и вернуть результаты, которые лучше соответствуют этим предпочтениям. Представитель не уточнил, какие сигналы используются или как они взвешиваются.

Почему это важно

Изображения становятся все более важными для команд, работающих над поисковой оптимизацией (SEO) и онлайн-продажами. Поскольку Google улучшает свои возможности по анализу изображений, использование отличных фотографий продуктов и снимков образа жизни может помочь вашему сайту занять более высокие позиции в рейтинге и привлечь больше клиентов.

Google обновляет свой Shopping Graph каждый час, поэтому крайне важно убедиться, что информация о вашем продукте актуальна и корректна.

С тем, как всё больше людей используют изображения и обращаются к поисковым системам, имейте в виду, что покупатели часто начинают с картинки или общей идеи, а не с конкретных поисковых запросов.

Заглядывая в будущее

На этой неделе Google запускает новый опыт для пользователей в США, использующих английский язык. Они не объявили, когда он станет доступен на других языках или в других странах.

Смотрите также

- Акции NLMK. НЛМК: прогноз акций.

- Какой самый низкий курс евро к южноафриканскому рэнду?

- Анализ динамики цен на криптовалюту ETH: прогнозы эфириума

- Акции RNFT. РуссНефть: прогноз акций.

2025-09-30 16:39